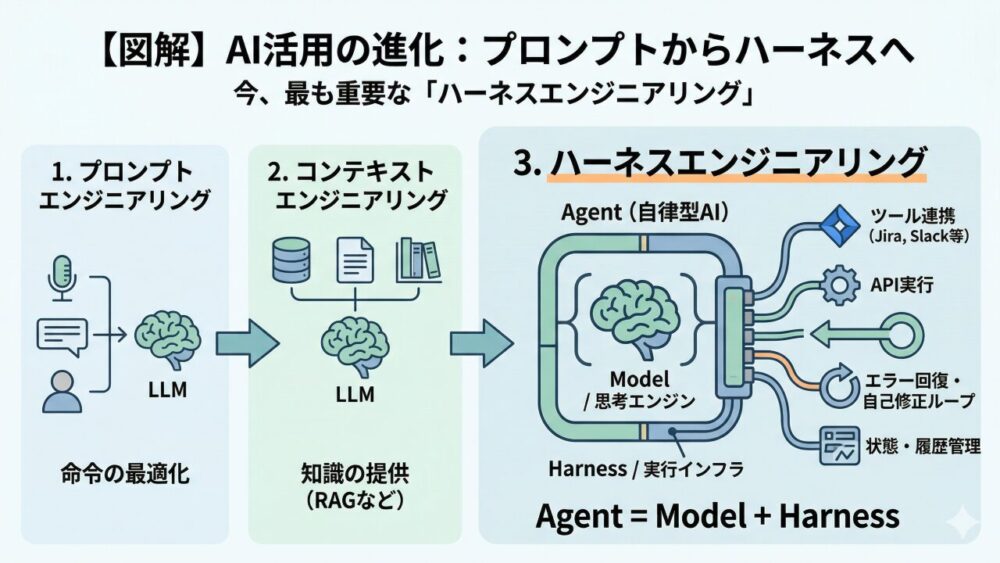

AI技術の進化は、私たち人間が大規模言語モデル(LLM)に対して「どのような呪文を唱えるか」という局所的な最適化から、システム全体として「AIをどう制御し、実務に組み込むか」というソフトウェア工学的なアプローチへと移行しています。

これまでの潮流であった「プロンプトエンジニアリング」、そして「コンテキストエンジニアリング」。これらに続き、今最も注目され、ソフトウェアエンジニアリングの最前線で語られているのが「ハーネスエンジニアリング(Harness Engineering)」です。

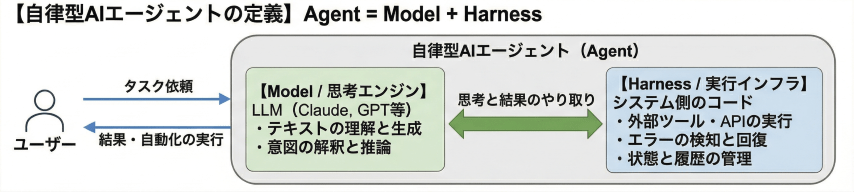

現在の業界トレンドにおいて、真の自律型AIは 「Agent = Model + Harness」 と定義されます。本記事では、この定義の真意を紐解きながら、より高度な業務自動化を例に挙げ、これら3つの手法がどう組み合わさるのかを徹底解説します。

原則:「Agent = Model + Harness」という新定義

「ハーネス(Harness)」とは、馬具や安全ベルト、あるいはハードウェアとソフトウェアを繋ぐ配線(ワイヤーハーネス)を意味する言葉です。

これまで私たちは、より賢い返答を得るために、プロンプト(命令)を工夫し、コンテキスト(知識)を与えてきました。しかし、AIを「自律的に動くエージェント」としてシステムに組み込む場合、LLM(モデル)単体では限界があります。

最新のAI開発の現場(OpenAIなどの最先端企業)では、「人間はプロンプトの微調整に時間をかけるのではなく、AIが能力を最大限に発揮し、失敗しても自己回復できる『環境(ハーネス)』の設計に注力すべきである」という方針が主流になっています。

つまり、ハーネスエンジニアリングとは、特定のLLMの機能に依存した小技ではなく、AIがツール(APIなど)を使いこなし、エラーから立ち直り、テストされながら安定稼働するための「周辺システム(インフラ)の構築」を指します。

具体的な課題:週報からチケット起票〜Slack通知までを全自動化する

ハーネスエンジニアリングの凄さを理解するために、単なる「文章の要約」ではなく、「複数ステップにまたがる自律型AIエージェントの開発」を題材にしてみましょう。

【やりたいこと(自律型エージェントのシナリオ)】

この課題に対し、3つのエンジニアリング手法を順番に適用し、AIがどう振る舞うかを見ていきましょう。

第1段階:プロンプトエンジニアリング(命令の最適化)

まずは、AIに対する「指示」だけで解決しようとする段階です。

【アプローチ】 AIに「週報を読んで、未完了タスクを見つけてJiraに起票し、Slackで連絡して」とプロンプトでお願いします。

【結果:失敗】 AIは「はい、わかりました!チケットを起票しておきます」と文字で出力するだけです。AI自体はブラウザを操作したりAPIを叩いたりする「手足」を持っていません。プロンプトエンジニアリングは「言い方」を最適化するだけなので、システムとしての実行力はゼロです。

第2段階:コンテキストエンジニアリング(情報の最適化)

次に、AIが判断を下すための「前提知識」を整理して提供する段階です(RAGなど)。

【アプローチ】 「JiraのAPI仕様書」や「SlackのメンバーID一覧」、「チケット起票のルール」といったコンテキスト(外部情報)をプロンプトと一緒に渡します。

【結果:不完全】 AIは「社員Aの未完了タスクを発見しました。これをJiraに登録するためのAPIリクエスト用JSONコードを作成しました」と、完璧なデータを出力してくれるようになります。 しかし、ここでも限界が来ます。AIが生成したコードを「誰が実行するのか?」、そして「APIがエラーを返してきた時(例:必須項目が足りない)、誰がAIに修正を依頼するのか?」という問題が残されたままです。

第3段階:ハーネスエンジニアリング(実行環境とインフラの構築)

ここでついに、人間が行う「ハーネスエンジニアリング」が登場します。AI(Model)の周りに、強力なシステムの枠組み(Harness)をコーディングして実装します。

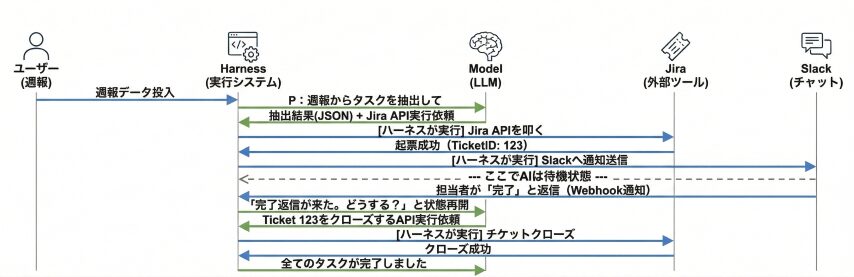

全体のフロー図(ハーネスがどうAIを制御するか)

【ハーネスとして実装される3つの仕組み】

- ツール連携と実行ループ(Tool Use & Execution Loop) AIが「JiraのAPIを叩きたい」という意図を出力した際、それをシステム側(PythonやNode.jsで書かれたハーネス)がキャッチし、実際にAPIを実行します。そして、成功したかどうかの結果を再びAIにフィードバックする無限ループを作ります。

- エラーからの自己回復(Error Recovery / Self-Correction) Jiraから「担当者IDが存在しません」というエラーが返ってきた場合、ハーネスはシステムを強制終了させるのではなく、そのエラーメッセージをAIに投げ返します。「エラーが出ました。別のIDで再試行してください」と指示ループを回すことで、AI自身に問題を解決させます。

- 非同期イベントの待機(Event Driven & State Management) 担当者からのSlackの返信は、数日後かもしれません。ハーネスは、AIがどの処理の途中だったのか(状態管理)をデータベースに保存し、Slackからの応答を待機します。Webhook(通知)を受け取った瞬間にAIを起こし、「担当者が完了したと言っています。チケットをクローズせよ」と再稼働させます。

【この段階の到達点】 ここまで構築して初めて、LLMは単なる「テキスト生成器」から、業務を自動遂行する「自律型AIエージェント(Agent = Model + Harness)」へと昇華されます。

「評価とテスト(Evaluation)」もハーネスの重要要素

ソフトウェア開発において、テストコードのないシステムは実稼働させられません。AIも同様です。ハーネスエンジニアリングでは、「AIの振る舞いを自動テストする仕組み(CI/CDパイプラインへの組み込み)」も非常に重要視されます。

評価ハーネス(Evaluation Harness): プロンプトを少し変更した際、「これまでの100件のテスト用週報データを取り込み、すべてのJiraチケットが正しく起票されるか、正しくSlack通知が飛ぶか」を一括で自動テストするインフラです。これにより、「AIが賢くなったつもりが、実は別のタスクが壊れていた(リグレッション)」という事態をシステム的に防ぎます。

最新トレンド「MCP」という強力なハーネス標準規格

自律型AIエージェントに外部ツール(JiraやSlack、社内データベースなど)を操作させる際、これまでは開発者がそれぞれのツールの仕様に合わせて個別にコード(ハーネス)を書く必要がありました。

しかし現在、このツール連携を標準化する動きとして「MCP(Model Context Protocol)」が急速に業界のトレンドとなっています。Anthropic社などが提唱するこの規格は、AIモデルと外部データソースやツールとの間で、安全かつ共通の言語で双方向通信を行うためのルールです。

MCP対応のサーバーを立てておくことで、「AIが外部ツールを安全に呼び出すための道(ハーネスの一部)」が最初から整備されている状態を作ることができます。これもまさに、現代の高度なハーネスエンジニアリングの一環であり、今後AIシステムを構築する上でのデファクトスタンダードになる強力なアプローチです。

各AIプラットフォームは「ハーネスを作るための部品」を提供している

各AIブランド(OpenAI、Anthropic、Googleなど)は、開発者がより簡単に堅牢なハーネスを作れるよう、LLM側に強力な「インターフェース(部品)」を実装し始めています。これらはハーネスそのものではなく、人間がハーネスを構築するために提供される武器です。

OpenAI (ChatGPT / GPT-4o)

Structured Outputs(構造化出力): AIが必ず指定したJSON Schema(データ構造)で出力することを100%保証する機能です。ハーネス側のプログラム(Pythonなど)が「AIの出力形式が崩れてパースエラーになる」という致命的弱点を克服するための最強の部品です。

Anthropic (Claude)

Tool Use(ツール呼び出し)と XMLによる思考の分離: Claudeは外部ツールを呼び出す能力に非常に長けています。また、<thinking> や <tool_choice> といったXMLタグを使って「思考プロセス」と「実行命令」を明確に分離して出力するため、ハーネス側でAIの意図をパース(解析)しやすくなっています。

Google (Gemini)

Google Workspaceとのシステムレベル統合: 他社が個別API経由での連携を前提とする中、Geminiの強みはGoogle製品(Docs、Drive、Gmail等)が最初から「強固なハーネス込み」で構築されている点です。さらに、数百万トークンという超長文コンテキストを扱えるため、途轍もない量のログや過去の状態(State)を保持したままエージェントに長期タスクを行わせることが可能です。

まとめ:プロンプト職人から「システム設計者」へ

AIを使いこなすためのアプローチは、以下の段階を経て進化しています。

これからの時代、本当に価値を生み出し、実業務のプロセスを自動化していくために必要なのは、魔法のプロンプトを見つけることではありません。AIを「エンジンの部品(Model)」として捉え、自律駆動させるための車体や自動テスト環境(Harness)を構築できるシステム設計のスキルです。

「Agent = Model + Harness」

この定義を胸に、日常のタスクを単にお願いするだけでなく、「AIが安全かつ確実に行動できる仕組み」をどう作るか、という一段高い視点でAI活用に取り組んでみてください。